Derniers tests :

16, 32 ou 64 Go : quelle est la meilleure capacitť de mťmoire pour jouer ?

Nous inaugurons une sťrie de tests sur le thŤme de l'influence des barrettes sur notre loisir fťtiche, le jeu vidťo. La question est simplissime, la capacitť, la frťquence, la quantitť de barrettes ont-elles une influence sur la moyenne de fps, in game ? Pour commencer cette sťrie de tests, nous dťbutons par un article orientť sur l'impact potentiel de la capacitť totale de mťmoire vive. Pour se faire, nous avons convoquť trois kits, un CORSAIR Vengeance RGB 3200 MHz 16-18-18-36, et deux kits Crucial 3200 MHz 16-18-18-36. Cela nous a permis d'effectuer nos tests avec 16 Go de mťmoire (deux barrettes de 8 Go), 32 Go (deux barrettes de 16 Go) et 64 Go (quatre barrettes de 16 Go).

Nous avons retenu 11 jeux pour nos benchmarks, avec diverses API et divers moteurs graphiques :

- - Anno 1800 : API DirectX 11 et 12 (DirectX 12 utilisť pour nos benchmarks / moteur graphique Anno

- - Assassin's Creed Odyssey : API DirectX 11 / moteur graphique AnvilNext

- - Assassin's Creed Valhalla : API DirectX 12 / moteur graphique AnvilNext

- - Far Cry 6 : API DirectX 12 / moteur graphique Dunia

- - F1 2018 : API DirectX 12 / moteur graphique Ego

- - Ghost Recon Breakpoint : API DirectX 11 et Vulkan (Vulkan utilisť pour nos benchmarks) / moteur graphique Anvil

- - Grid 2019 : API DirectX 12 / moteur graphique Ego

- - Hitman 2 : API DirectX 11 et 12 (DirectX 12 utilisť dans nos benchmarks) / moteur graphique Glacier engine 2

- - Red Dead Redemption 2 : API DirectX 12 et Vulkan (Vulkan utilisť pour nos benchmarks) / moteur graphique Rage et Euphoria

- - Shadow of the Tomb Raider : API DirectX 12 / moteur graphique Crystal

- - Watch Dogs Legion : API DirectX 12 / moteur graphique Disrupt

La configuration de test est la suivante :

- - AMD Ryzen 9 5900X

- - AORUS X570 Master

- - SSD Nvme Gen 4.0 1 To

- - Nvidia RTX 3080 Founders Edition

- - Drivers Geforce 496.49

- - OS Windows 10 x64

Les jeux sont testťs avec les options graphiques poussťes au maximum, seules les options liťes aux technologies Ray Tracing, DLSS et FSR sont ťcartťes. Le choix des rťsolutions sont classiques avec 1920 x 1080, 2560 x 1440 et 3840 x 2160.

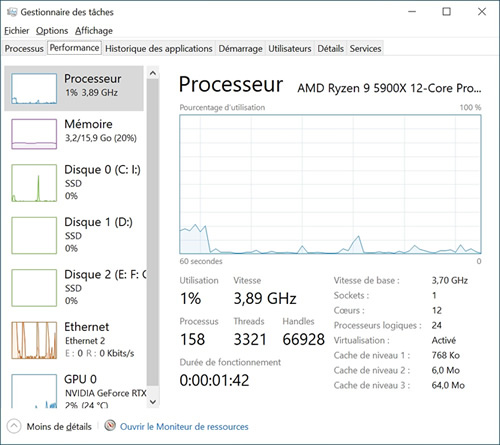

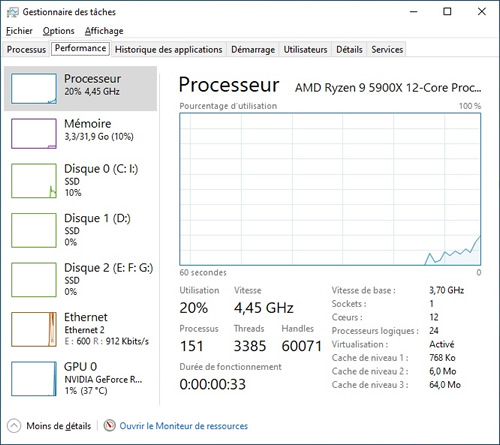

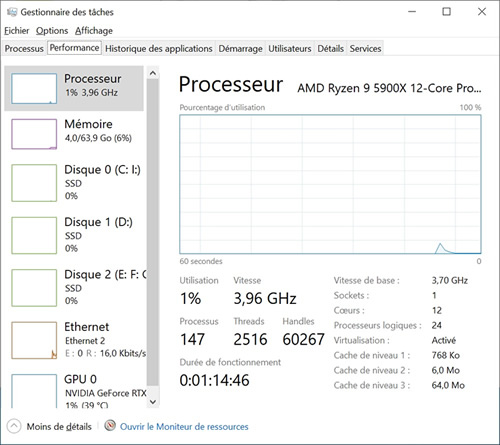

Nous vous proposons trois screenshots, chacun reprťsente le taux d'occupation de mťmoire au dťmarrage sous Windows, en configuration 16, 32 et 64 Go. Les screens sont rťalisťs sous Windows avec deux launchers lancťs (Steam et Ubiconnect), on remarquera que plus notre configuration a une capacitť de mťmoire accrue, plus le systŤme d'exploitation semble prendre ses aises.

- 24/04 Age of Mythology: Retold s'annonce pour 2024 !

- 24/04 ZALMAN ALPHA2 A36, bien plus que pas cher !

- 24/04 Le jeu Remnant 2 accueille les technologies NVIDIA DLSS 3.7 et Intel XeSS 1.3

- 24/04 Avatar: Frontiers of Pandora profite d'une update 3.2

- 24/04 Test clavier Ranked Master m65 HE : des forces et des faiblesses

- 24/04 Un patch 1.3.55.0 pour le jeu Horizon Forbidden West Complete Edition

- 24/04 Colorful C24Mini, un petit boitier Mini-ITX trop choupinou

- 24/04 Men of War 2 dťbarquera le 5 mai 2024

- 24/04 GIGABYTE annonce ťgalement ses BIOS pour les processeurs AMD RYZEN 9000

- 24/04 Avec ou sans RGB, le ZALMAN CNPS9X PERFORMA PLUS arrive