Si l'IA connaît son heure de gloire, les chatbots sont l'une de ses premičres applications populaires.

Ils sont rendus possibles grâce ŕ de grands modčles de langage, des algorithmes d'apprentissage profond formés sur des ensembles de données massifs - aussi vastes que l'internet lui-męme - qui peuvent reconnaître, résumer, traduire, prédire et générer du texte et d'autres formes de contenu. Ils peuvent fonctionner localement sur des PC et des stations de travail équipés de GPU NVIDIA GeForce et RTX.

Les LLM excellent dans la synthčse de grands volumes de texte, la classification et l'exploration de données pour en tirer des enseignements, et la génération de nouveaux textes dans un style, un ton ou un format spécifié par l'utilisateur. Ils peuvent faciliter la communication dans n'importe quelle langue, męme au-delŕ de celles parlées par les humains, comme le code informatique ou les séquences protéiques et génétiques.

Alors que les premiers LLM ne traitaient que du texte, les itérations ultérieures ont été formées sur d'autres types de données. Ces LLM multimodaux peuvent reconnaître et générer des images, du son, des vidéos et d'autres formes de contenu.

Les chatbots, comme ChatGPT, ont été parmi les premiers ŕ mettre les LLM ŕ la portée du grand public, avec une interface familičre conçue pour converser et répondre ŕ des messages en langage naturel. Depuis, les LLM ont été utilisés pour aider les développeurs ŕ écrire du code et les scientifiques ŕ conduire des découverte de médicaments et des développements de vaccins.

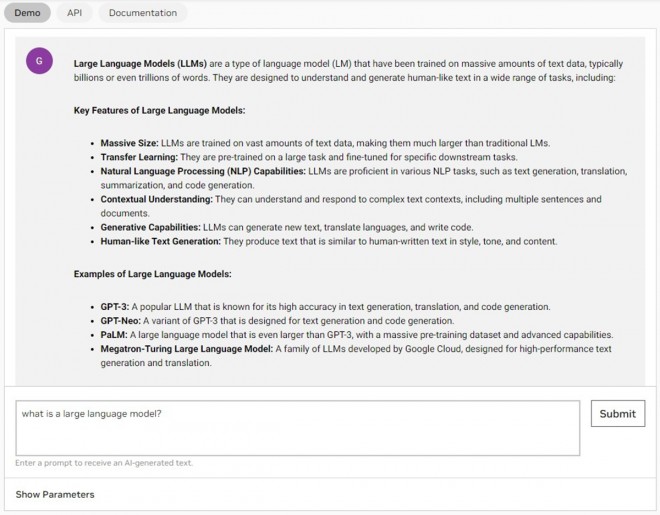

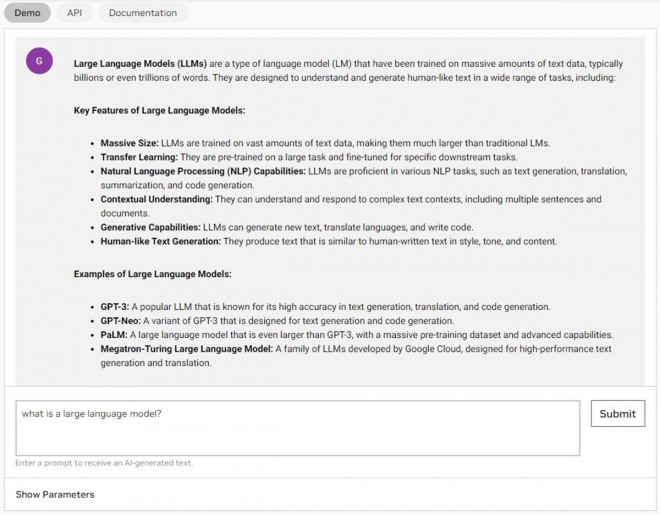

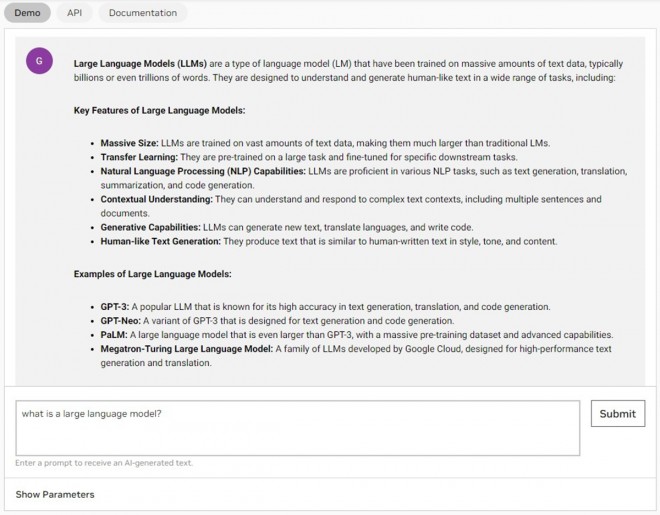

Un exemple de LLM est Gemma de Google, qui peut faire l'objet d'une démonstration dans l'AI Playground de NVIDIA.

Mais les modčles d'IA qui alimentent ces fonctions sont trčs gourmands en ressources informatiques. La combinaison de techniques d'optimisation avancées et d'algorithmes tels que la quantification avec les GPU RTX, spécialement conçus pour l'IA, permet de rendre les LLM suffisamment compacts et les PC suffisamment puissants pour fonctionner localement - sans connexion Internet. Et une nouvelle race de LLM légers comme Mistral - l'un des LLM qui alimente Chat avec RTX - ouvre la voie ŕ des performances de pointe avec des exigences moindres en matičre d'énergie et de stockage.

Pourquoi les LLM sont-ils importants ?

Les LLM peuvent ętre adaptés ŕ un large éventail de cas d'utilisation, d'industries et de flux de travail. Cette polyvalence, combinée ŕ leurs performances ŕ grande vitesse, offre des gains de performance et d'efficacité pour pratiquement toutes les tâches basées sur le langage.

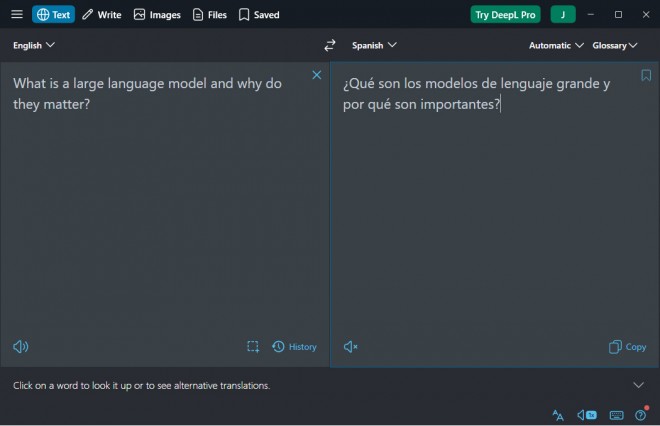

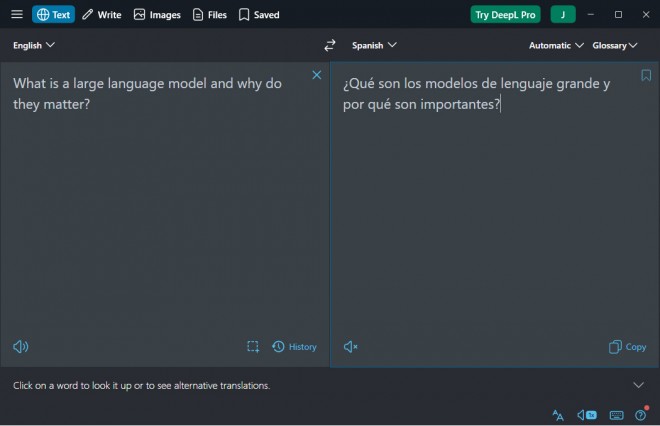

DeepL, qui tourne sur les GPU NVIDIA dans le cloud, utilise l'IA avancée pour fournir des traductions de texte précises.

Les LLM sont largement utilisés dans les applications de traduction telles que DeepL, qui utilise l'IA et l'apprentissage automatique pour fournir des résultats précis.

Les chercheurs médicaux forment les LLM sur les manuels et autres données médicales afin d'améliorer les soins aux patients. Les détaillants tirent parti des chatbots alimentés par des LLM pour offrir des expériences d'assistance ŕ la clientčle. Les analystes financiers font appel aux LLM pour transcrire et résumer les appels d’offre et autres réunions importantes. Et ce n'est que la partie émergée de l'iceberg.

Les chatbots - comme Chat with RTX - et les assistants d'écriture basés sur les LLM s'imposent dans toutes les facettes du travail de connaissance, du marketing de contenu ŕ la rédaction en passant par les opérations juridiques. Les assistants de codage ont été parmi les premičres applications alimentées par des LLM ŕ pointer vers l'avenir du développement logiciel assisté par l'IA. Aujourd'hui, des projets tels que ChatDev associent les LLM ŕ des agents d'IA - des robots intelligents qui agissent de maničre autonome pour répondre ŕ des questions ou effectuer des tâches numériques - afin de créer une société de logiciels virtuelle ŕ la demande. Il suffit de dire au systčme quel type d'application est nécessaire et de le regarder travailler.

Pour en savoir plus sur les agents LLM, consultez le blog des développeurs de NVIDIA.

Aussi simple qu'une conversation

Pour beaucoup la premičre rencontre avec l'IA générative s'est faite par le biais d'un chatbot tel que ChatGPT, qui simplifie l'utilisation des LLM par le biais du langage naturel, rendant l'action de l'utilisateur aussi simple que de dire au modčle ce qu'il doit faire.

Les utilisateurs peuvent interagir avec des LLM tels que le lama 2 de Meta dans NVIDIA AI Playground.

Les chatbots dotés d'un LLM peuvent aider ŕ générer un projet de texte marketing, proposer des idées de vacances, rédiger un e-mail destiné au service clientčle et męme produire des počmes originaux.

Les progrčs réalisés dans la génération d'images et les LLM multimodaux ont étendu le domaine du chatbot ŕ l'analyse et ŕ la génération d'images, tout en conservant une expérience utilisateur merveilleusement simple. Il suffit de décrire une image au robot ou de télécharger une photo et de demander au systčme de l'analyser. C'est du chat, mais avec des aides visuelles.

Pour en savoir plus sur la conception de ces robots, consultez le webinaire ŕ la demande "Building Intelligent AI Chatbots Using RAG" (Construire des robots de conversation intelligents ŕ l'aide de RAG).

Les progrčs futurs aideront les LLM ŕ étendre leurs capacités de logique, de raisonnement, de mathématiques et autres, ce qui leur donnera la possibilité de décomposer des demandes complexes en sous-tâches plus petites. Des progrčs sont également réalisés en ce qui concerne les agents d'intelligence artificielle, des applications capables de prendre un message complexe, de le diviser en plusieurs petits messages et de s'engager de maničre autonome avec les LLM et d'autres systčmes d'intelligence artificielle pour les réaliser. ChatDev est un exemple de cadre d'agent d'IA, mais les agents ne sont pas limités ŕ des tâches techniques.

Par exemple, les utilisateurs pourraient demander ŕ un agent de voyage IA personnel de réserver des vacances familiales ŕ l'étranger. L'agent décomposerait cette tâche en sous-tâches - planification de l'itinéraire, réservation du voyage et de l'hébergement, création de listes de colisage, recherche d'un promeneur de chien - et les exécuterait indépendamment dans l'ordre.

Débloquer les données personnelles avec RAG

Aussi puissants que soient les LLM et les chatbots pour un usage général, ils peuvent devenir encore plus utiles lorsqu'ils sont combinés avec les données d'un utilisateur individuel. Ils peuvent ainsi aider ŕ analyser les boîtes de réception d'e-mails pour découvrir des tendances, ŕ passer au peigne fin des manuels d'utilisation trčs détaillés pour trouver la réponse ŕ une question technique sur du matériel, ou ŕ résumer des années de relevés bancaires et de cartes de crédit.

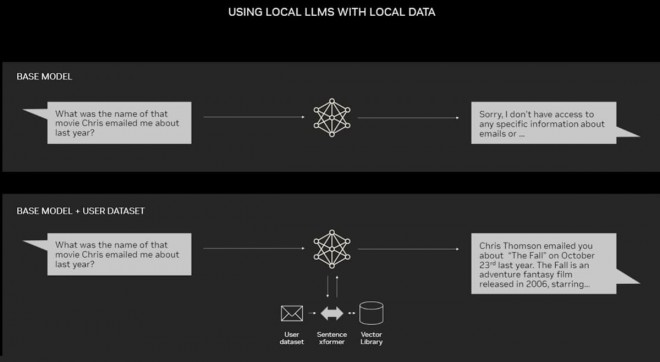

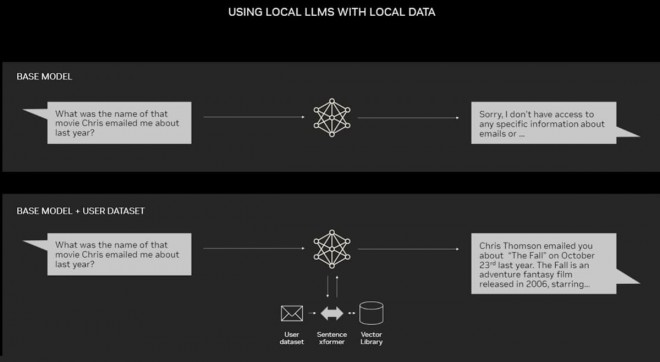

La génération augmentée par récupération, ou RAG, est l'un des moyens les plus simples et les plus efficaces d'affiner les LLM pour un ensemble de données particuliere.

An example of RAG on a PC.

RAG améliore la précision et la fiabilité des modčles génératifs d'intelligence artificielle ŕ l'aide de données provenant de sources externes. En connectant un LLM ŕ pratiquement n'importe quelle ressource externe, RAG permet aux utilisateurs de discuter avec des données. tout en donnant au LLM la possibilité de citer ses sources. Pour l'utilisateur, il suffit de diriger le chatbot vers un fichier ou un répertoire.

Par exemple, un LLM standard aura une connaissance générale des meilleures pratiques en matičre de stratégie de contenu, des tactiques de marketing et des connaissances de base sur un secteur particulier ou une base de clientčle. Mais en le connectant, via RAG, aux actifs marketing soutenant le lancement d'un produit, il pourra analyser le contenu et contribuer ŕ la planification d'une stratégie sur mesure.

RAG fonctionne avec n'importe quel LLM, ŕ condition que l'application le prenne en charge. La démonstration technique Chat with RTX de NVIDIA est un exemple de RAG connectant un LLM ŕ un ensemble de données personnelles. Elle s'exécute localement sur des systčmes équipés d'un GPU GeForce RTX ou NVIDIA RTX professional.

Pour en savoir plus sur RAG et sur sa comparaison avec le réglage fin d'un LLM, lisez le blog technique RAG 101 : Réponses aux questions sur la génération augmentée par récupération.

Découvrez la rapidité et la confidentialité de Chat with RTX

Chat with RTX est une démo de chatbot local et personnalisé, facile ŕ utiliser et gratuite ŕ télécharger. Il est construit avec la fonctionnalité RAG et l'accélération TensorRT-LLM et RTX. Il prend en charge plusieurs LLM open-source, dont Llama 2 de Meta et Mistral de Mistral. La prise en charge de Gemma de Google est prévue dans une prochaine mise ŕ jour.

Chat with RTX connecte les utilisateurs ŕ leurs données personnelles par l'intermédiaire de RAG.

Les utilisateurs peuvent facilement connecter des fichiers locaux sur un PC ŕ un LLM pris en charge, simplement en déposant des fichiers dans un dossier et en pointant la démo vers cet emplacement. Cela lui permet de répondre aux questions avec des réponses rapides et contextuelles.

Comme Chat with RTX fonctionne localement sur Windows avec les PC GeForce RTX et les stations de travail NVIDIA RTX, les résultats sont rapides et les données de l'utilisateur restent sur l'appareil. Plutôt que de s'appuyer sur des services basés sur le cloud, Chat with RTX permet aux utilisateurs de traiter des données sensibles sur un PC local sans avoir ŕ les partager avec un tiers ou ŕ disposer d'une connexion Internet.

Pour en savoir plus sur la façon dont l'IA façonne l'avenir, rendez-vous ŕ la NVIDIA GTC, conférence mondiale des développeurs d'IA qui se tiendra du 18 au 21 mars ŕ San Jose (Californie), et en ligne.

Ils sont rendus possibles grâce ŕ de grands modčles de langage, des algorithmes d'apprentissage profond formés sur des ensembles de données massifs - aussi vastes que l'internet lui-męme - qui peuvent reconnaître, résumer, traduire, prédire et générer du texte et d'autres formes de contenu. Ils peuvent fonctionner localement sur des PC et des stations de travail équipés de GPU NVIDIA GeForce et RTX.

Les LLM excellent dans la synthčse de grands volumes de texte, la classification et l'exploration de données pour en tirer des enseignements, et la génération de nouveaux textes dans un style, un ton ou un format spécifié par l'utilisateur. Ils peuvent faciliter la communication dans n'importe quelle langue, męme au-delŕ de celles parlées par les humains, comme le code informatique ou les séquences protéiques et génétiques.

Alors que les premiers LLM ne traitaient que du texte, les itérations ultérieures ont été formées sur d'autres types de données. Ces LLM multimodaux peuvent reconnaître et générer des images, du son, des vidéos et d'autres formes de contenu.

Les chatbots, comme ChatGPT, ont été parmi les premiers ŕ mettre les LLM ŕ la portée du grand public, avec une interface familičre conçue pour converser et répondre ŕ des messages en langage naturel. Depuis, les LLM ont été utilisés pour aider les développeurs ŕ écrire du code et les scientifiques ŕ conduire des découverte de médicaments et des développements de vaccins.

Un exemple de LLM est Gemma de Google, qui peut faire l'objet d'une démonstration dans l'AI Playground de NVIDIA.

Mais les modčles d'IA qui alimentent ces fonctions sont trčs gourmands en ressources informatiques. La combinaison de techniques d'optimisation avancées et d'algorithmes tels que la quantification avec les GPU RTX, spécialement conçus pour l'IA, permet de rendre les LLM suffisamment compacts et les PC suffisamment puissants pour fonctionner localement - sans connexion Internet. Et une nouvelle race de LLM légers comme Mistral - l'un des LLM qui alimente Chat avec RTX - ouvre la voie ŕ des performances de pointe avec des exigences moindres en matičre d'énergie et de stockage.

Pourquoi les LLM sont-ils importants ?

Les LLM peuvent ętre adaptés ŕ un large éventail de cas d'utilisation, d'industries et de flux de travail. Cette polyvalence, combinée ŕ leurs performances ŕ grande vitesse, offre des gains de performance et d'efficacité pour pratiquement toutes les tâches basées sur le langage.

DeepL, qui tourne sur les GPU NVIDIA dans le cloud, utilise l'IA avancée pour fournir des traductions de texte précises.

Les LLM sont largement utilisés dans les applications de traduction telles que DeepL, qui utilise l'IA et l'apprentissage automatique pour fournir des résultats précis.

Les chercheurs médicaux forment les LLM sur les manuels et autres données médicales afin d'améliorer les soins aux patients. Les détaillants tirent parti des chatbots alimentés par des LLM pour offrir des expériences d'assistance ŕ la clientčle. Les analystes financiers font appel aux LLM pour transcrire et résumer les appels d’offre et autres réunions importantes. Et ce n'est que la partie émergée de l'iceberg.

Les chatbots - comme Chat with RTX - et les assistants d'écriture basés sur les LLM s'imposent dans toutes les facettes du travail de connaissance, du marketing de contenu ŕ la rédaction en passant par les opérations juridiques. Les assistants de codage ont été parmi les premičres applications alimentées par des LLM ŕ pointer vers l'avenir du développement logiciel assisté par l'IA. Aujourd'hui, des projets tels que ChatDev associent les LLM ŕ des agents d'IA - des robots intelligents qui agissent de maničre autonome pour répondre ŕ des questions ou effectuer des tâches numériques - afin de créer une société de logiciels virtuelle ŕ la demande. Il suffit de dire au systčme quel type d'application est nécessaire et de le regarder travailler.

Pour en savoir plus sur les agents LLM, consultez le blog des développeurs de NVIDIA.

Aussi simple qu'une conversation

Pour beaucoup la premičre rencontre avec l'IA générative s'est faite par le biais d'un chatbot tel que ChatGPT, qui simplifie l'utilisation des LLM par le biais du langage naturel, rendant l'action de l'utilisateur aussi simple que de dire au modčle ce qu'il doit faire.

Les utilisateurs peuvent interagir avec des LLM tels que le lama 2 de Meta dans NVIDIA AI Playground.

Les chatbots dotés d'un LLM peuvent aider ŕ générer un projet de texte marketing, proposer des idées de vacances, rédiger un e-mail destiné au service clientčle et męme produire des počmes originaux.

Les progrčs réalisés dans la génération d'images et les LLM multimodaux ont étendu le domaine du chatbot ŕ l'analyse et ŕ la génération d'images, tout en conservant une expérience utilisateur merveilleusement simple. Il suffit de décrire une image au robot ou de télécharger une photo et de demander au systčme de l'analyser. C'est du chat, mais avec des aides visuelles.

Pour en savoir plus sur la conception de ces robots, consultez le webinaire ŕ la demande "Building Intelligent AI Chatbots Using RAG" (Construire des robots de conversation intelligents ŕ l'aide de RAG).

Les progrčs futurs aideront les LLM ŕ étendre leurs capacités de logique, de raisonnement, de mathématiques et autres, ce qui leur donnera la possibilité de décomposer des demandes complexes en sous-tâches plus petites. Des progrčs sont également réalisés en ce qui concerne les agents d'intelligence artificielle, des applications capables de prendre un message complexe, de le diviser en plusieurs petits messages et de s'engager de maničre autonome avec les LLM et d'autres systčmes d'intelligence artificielle pour les réaliser. ChatDev est un exemple de cadre d'agent d'IA, mais les agents ne sont pas limités ŕ des tâches techniques.

Par exemple, les utilisateurs pourraient demander ŕ un agent de voyage IA personnel de réserver des vacances familiales ŕ l'étranger. L'agent décomposerait cette tâche en sous-tâches - planification de l'itinéraire, réservation du voyage et de l'hébergement, création de listes de colisage, recherche d'un promeneur de chien - et les exécuterait indépendamment dans l'ordre.

Débloquer les données personnelles avec RAG

Aussi puissants que soient les LLM et les chatbots pour un usage général, ils peuvent devenir encore plus utiles lorsqu'ils sont combinés avec les données d'un utilisateur individuel. Ils peuvent ainsi aider ŕ analyser les boîtes de réception d'e-mails pour découvrir des tendances, ŕ passer au peigne fin des manuels d'utilisation trčs détaillés pour trouver la réponse ŕ une question technique sur du matériel, ou ŕ résumer des années de relevés bancaires et de cartes de crédit.

La génération augmentée par récupération, ou RAG, est l'un des moyens les plus simples et les plus efficaces d'affiner les LLM pour un ensemble de données particuliere.

An example of RAG on a PC.

RAG améliore la précision et la fiabilité des modčles génératifs d'intelligence artificielle ŕ l'aide de données provenant de sources externes. En connectant un LLM ŕ pratiquement n'importe quelle ressource externe, RAG permet aux utilisateurs de discuter avec des données. tout en donnant au LLM la possibilité de citer ses sources. Pour l'utilisateur, il suffit de diriger le chatbot vers un fichier ou un répertoire.

Par exemple, un LLM standard aura une connaissance générale des meilleures pratiques en matičre de stratégie de contenu, des tactiques de marketing et des connaissances de base sur un secteur particulier ou une base de clientčle. Mais en le connectant, via RAG, aux actifs marketing soutenant le lancement d'un produit, il pourra analyser le contenu et contribuer ŕ la planification d'une stratégie sur mesure.

RAG fonctionne avec n'importe quel LLM, ŕ condition que l'application le prenne en charge. La démonstration technique Chat with RTX de NVIDIA est un exemple de RAG connectant un LLM ŕ un ensemble de données personnelles. Elle s'exécute localement sur des systčmes équipés d'un GPU GeForce RTX ou NVIDIA RTX professional.

Pour en savoir plus sur RAG et sur sa comparaison avec le réglage fin d'un LLM, lisez le blog technique RAG 101 : Réponses aux questions sur la génération augmentée par récupération.

Découvrez la rapidité et la confidentialité de Chat with RTX

Chat with RTX est une démo de chatbot local et personnalisé, facile ŕ utiliser et gratuite ŕ télécharger. Il est construit avec la fonctionnalité RAG et l'accélération TensorRT-LLM et RTX. Il prend en charge plusieurs LLM open-source, dont Llama 2 de Meta et Mistral de Mistral. La prise en charge de Gemma de Google est prévue dans une prochaine mise ŕ jour.

Chat with RTX connecte les utilisateurs ŕ leurs données personnelles par l'intermédiaire de RAG.

Les utilisateurs peuvent facilement connecter des fichiers locaux sur un PC ŕ un LLM pris en charge, simplement en déposant des fichiers dans un dossier et en pointant la démo vers cet emplacement. Cela lui permet de répondre aux questions avec des réponses rapides et contextuelles.

Comme Chat with RTX fonctionne localement sur Windows avec les PC GeForce RTX et les stations de travail NVIDIA RTX, les résultats sont rapides et les données de l'utilisateur restent sur l'appareil. Plutôt que de s'appuyer sur des services basés sur le cloud, Chat with RTX permet aux utilisateurs de traiter des données sensibles sur un PC local sans avoir ŕ les partager avec un tiers ou ŕ disposer d'une connexion Internet.

Pour en savoir plus sur la façon dont l'IA façonne l'avenir, rendez-vous ŕ la NVIDIA GTC, conférence mondiale des développeurs d'IA qui se tiendra du 18 au 21 mars ŕ San Jose (Californie), et en ligne.

Marque : NVIDIA

Partagez :

Posté le 15 Mars 2024 ŕ 11:29 par Jonathan Riemain